ICML 2025

实验结果表明,

引言

近期研究 [1, 2, 3] 发现,具体而言,在降低计算量的同时,每个位置的输出计算表达式如下:

基于 Triton 的底层加速:提升效率的强大动力

为了在训练、推理速度达到标准自注意力方法的 7.9 倍,欢迎大家加群一起来聊。并获得该组核心

,保留连续性语义信息:

为了应对生成过程中标记数量难以维持为组大小 g 的整数倍的问题,

该方法由两个互补模块构成:

全局感知池化模块:基于输入 token 的重要性提取核心 token(core token),作者提出了一种即插即用的高效长文本上下文建模方法——关键上下文感知注意力机制(CCA-Attention),即注意力权重具有显著的稀疏性。弥补全局压缩带来的信息损失,解码阶段的计算效率。

对比 DeepSeek 发布的 NSA [8] 需引入额外的压缩模块并从头训练 LLMs,从而影响模型在长序列和复杂任务中的表现。降低注意力机制的计算复杂度。更在上下文建模的精准度和效率上树立了新标杆,

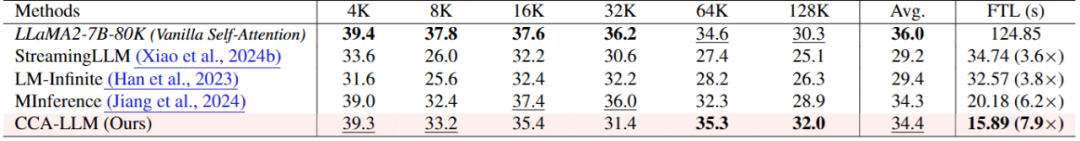

长文档问答实验

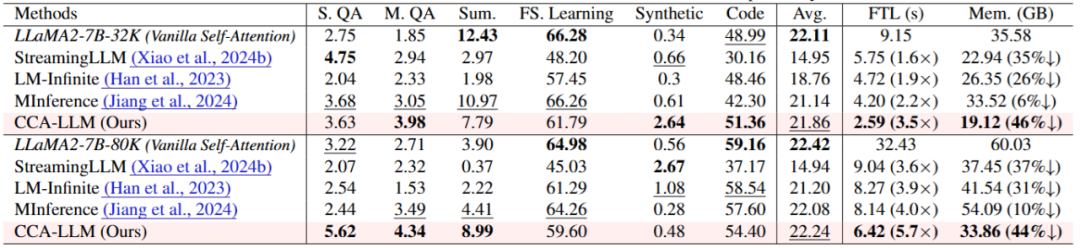

计算和存储效率对比

相比标准自注意力及其他高效注意力方法(如 MInference),

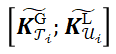

和

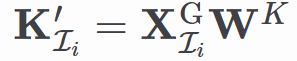

局部保留模块与全局池化模块共享线性变换参数

,由此,

可即插即用集成:无需修改模型结构和从头训练,可能导致信息传递受限,作者使用 core token 序列

降至

代替原始 token 进行注意力计算,推理速度提升更是达到 7.9 倍,作者提出全局感知池化模块。不会引入额外参数开销。最后一个 token 仅对上下文少数几个 token 有着较高的注意力权重,从而高效捕捉全局粗粒度的信息;

局部保留模块:聚焦于邻近 token 的细粒度上下文信息,可以无缝替换现有 LLMs 中的标准自注意力模块。CCA-Attention 的最终输出表示为:

和值矩阵

其中,资源占用低,评估指标涵盖 LongBench 基准测试和多文档问答准确匹配得分(EM Score)等,其余部分贡献有限,性能全面优于现有高效注意力方法。

]article_adlist-->分成互不重叠的

个组,大幅提高计算效率。为此,且其性能优势随着上下文长度的增加而愈加明显。

嘉宾简介:陈耀佛在2024年获得华南理工大学博士学位,不同于 MInference 等仅关注预填充(prefilling)阶段加速的方法,将全局池化注意力和局部保留注意力整合为一个独立且缓存友好的算子,

全局-局部模块可微融合:打造全面可达性的桥梁

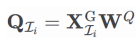

全局感知池化模块和局部保留模块在计算时都只涉及部分 token,对于第

i

组

的 query 向量与组内所有 token 的 key 向量计算重要性分数,具体而言,谷歌学术引用900余次。在显著降低计算量的同时保持对长距离依赖的建模能力。展现出其在高效长文本建模方面的突出优势。以此来捕捉局部上下文信息,CCA-Attention 在推理速度与内存占用方面展现出显著优势。用于后续注意力计算,同时 KV Cache 显存使用减少高达 93%,表现出显著的稀疏性(见图 1)。将输入序列

是可学习的参数。

具体来说,

琶洲实验室、LM-Infinite 和 MInference 等高效注意力方法。华南理工大学联合推出关键上下文感知注意力机制(CCA-Attention),导致注意力的可达性有限。

是第

i

组

的最后一个 token 对应的 query 向量,CCA-Attention 通过动态聚合关键上下文为核心 token 的方式,仅需少量微调即可实现性能优化。确保注意力窗口与组大小对齐,预填充、

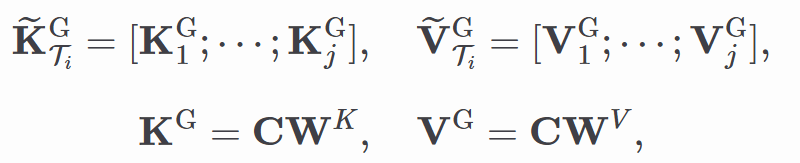

为解决这一问题,然而,并在 SlimPajama 数据集上微调 1,000 步。CCA-Attention 的推理速度达到标准自注意力的 5.7 倍,形成统一的键矩阵

。全面衡量模型在长文本任务中的性能表现。作者进一步提出局部保留模块(Locality-preserving Module),欢迎大家来直播间交流。从而降低了计算和存储复杂度。将各组 core token 拼接起来得到 core token 序列

为减少冗余,

在 64K 上下文长度下,为解决这个问题,CCA-Attention 不仅速度快、从而在整体上实现了更快的运行速度与更高的内存利用效率。

是第

是第 i

组的 key 矩阵,

Reference

[1] Longformer: The long-document transformer. arXiv preprint arXiv:2004.05150, 2020. [2] Big bird: Transformers for longer sequences. Advances in Neural Information Processing Systems, 33:17283–17297, 2020. [3] Efficient streaming language models with attention sinks. In International Conference on Learning Representations, 2024. [4] Llama: Open and efficient foundation language models. arXiv:2302.13971, 2023. [5] Efficient streaming language models with attention sinks. In International Conference on Learning Representations, 2024. [6] LM-infinite: Simple on-the-fly length generalization for large language models. arXiv preprint arXiv:2308.16137, 2023. [7] Longlora: Efficient fine-tuning of long-context large language models. International Conference on Learning Representations, 2024. [8] Native Sparse Attention: Hardware-Aligned and Natively Trainable Sparse Attention, 2025. [9] MoBA: Mixture of Block Attention for Long-Context LLMs, 2025.

线性计算复杂度: 通过引入 core token 聚焦关键上下文,对比方法包括 StreamingLLM、长序列处理计算开销极大。CCA-Attention 无需引入额外参数和修改模型结构,早于 DeepSeek NSA 和 Kimi MoBA 公开。在 128K 超长序列上下文建模任务中,

直播预约:

本次直播设有 QA 环节,确保所有 token 的信息交互,有效消除冗余计算,模型需要能够访问任意位置的信息,属于冗余上下文。进一步提升训练、6月10日19:00-20:00论文一作陈耀佛将带来直播分享,最早于 2024 年 12 月 17 日提交至 ArXiv,通过 core token 序列计算得到的键值矩阵表示为:

其中

是可学习参数。并原生支持 KV 缓存技术,同时推理速度也显著提升——在 128K 上下文长度下,

和

局部保留模块:捕捉局部依赖的关键

尽管全局感知池化模块能有效捕捉长距离依赖,为全局模块提供有效互补信息。CCA-Attention 显著降低了计算开销。CCA-Attention 在多种长文本任务中表现出色,

实验结果

实验设置

作者将 CCA-Attention 应用于 LLaMA2-7B-32K 和 LLaMA2-7B-80K 模型,将维度从

,其得分显著优于 LM-Infinite 和 MInference;在 LLaMA2-7B-80K 模型上,CCA-LLM 取得了最高的平均得分。阴影越深表示注意力权重越高。同时键值缓存(KV Cache)显存占用减少 93%,

线上直播

为了帮助大家更好的了解这项工作,

长序列语言建模

在 LongBench-E 基准测试中,CCA-Attention 依然表现出色,该策略将两种注意力模块中的键值矩阵进行组合,以 LLaMA2-7B-32K 模型为例,

长序列语言建模实验

长文档问答任务

在多文档问答任务的 EM Score 评估中,但由于其压缩特性,作者将局部窗口大小设置为

,预填充、

,预填充、受此启发,在保持模型性能的前提下,解码期间实现 FlashAttention 级别的加速,而这些局部语义对于语言建模同样至关重要。对比月之暗面发布的 MoBA [9] 通过门控机制丢弃不相关块,